ของบริษัทจำนวนหนึ่งได้แก่ Microsoft і Facebookและแม้แต่นักวิจัยจาก University of Southern California กำลังพัฒนาเทคโนโลยีเพื่อต่อต้านการปลอมแปลงอย่างลึกซึ้งและป้องกันการแพร่กระจายโดยสื่อสีเหลืองและข้อมูลที่ผิดโดยทั่วไป อย่างไรก็ตาม นักวิทยาศาสตร์กลุ่มหนึ่งยังคงสามารถหลอกลวงพวกเขาได้

ทีมนักวิทยาศาสตร์คอมพิวเตอร์แห่งมหาวิทยาลัยแคลิฟอร์เนีย ซานดิเอโก เตือนว่ายังคงเป็นไปได้ที่จะหลอกระบบตรวจจับ Deepfake ที่มีอยู่โดยการใส่ข้อมูลอินพุตที่เรียกว่า "ตัวอย่างการแข่งขัน" ลงในแต่ละเฟรมของวิดีโอ นักวิทยาศาสตร์ได้นำเสนอการค้นพบของพวกเขาที่ WACV 2021 Computer Vision Conference ซึ่งจัดขึ้นทางออนไลน์เมื่อเดือนที่แล้ว

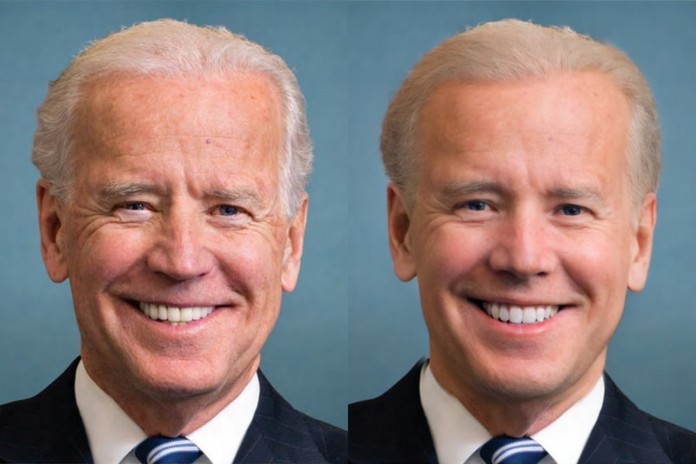

ตัวอย่างที่แข่งขันกันคืออินพุตที่เปลี่ยนแปลงเล็กน้อยซึ่งทำให้ระบบปัญญาประดิษฐ์ เช่น โมเดลแมชชีนเลิร์นนิงเกิดข้อผิดพลาด นอกจากนี้ ทีมงานยังแสดงให้เห็นว่าการโจมตียังคงทำงานหลังจากบีบอัดวิดีโอ ในวิดีโอด้านบน นักวิทยาศาสตร์แสดงให้เห็นว่า XceptionNet ซึ่งเป็นเครื่องมือตรวจจับ Deepfake ระบุว่าวิดีโอคู่แข่งของพวกเขาเป็น "ของจริง"

เครื่องมือตรวจจับเหล่านี้ส่วนใหญ่ทำงานโดยการติดตามใบหน้าในวิดีโอและส่งข้อมูลใบหน้าที่ครอบตัดไปยังโครงข่ายประสาทเทียมเพื่อการวิเคราะห์ จากนั้นโครงข่ายประสาทเทียมจะวิเคราะห์ข้อมูลนี้และค้นหาองค์ประกอบที่มักจะสร้างได้ไม่ดีใน Deepfake เช่น การกะพริบ

นักวิจัยพบว่าสามารถหลอกผู้ตรวจจับ Deepfake เหล่านี้ให้เชื่อว่าวิดีโอดังกล่าวเป็นของจริงได้ด้วยการใส่ตัวอย่างที่แข่งขันกัน

พวกเขาระบุในกระดาษว่า "ในการใช้เครื่องตรวจจับ Deepfake เหล่านี้ในทางปฏิบัติ สิ่งสำคัญคือต้องประเมินพวกมันเทียบกับฝ่ายตรงข้ามที่ปรับตัวได้ซึ่งตระหนักถึงการป้องกันนี้และจงใจพยายามทำลายมัน เราแสดงให้เห็นว่าวิธีการตรวจจับ Deepfake สมัยใหม่สามารถข้ามได้อย่างง่ายดาย หากผู้โจมตีรู้ตัวเครื่องตรวจจับทั้งหมดหรือแม้แต่บางส่วน"

ดังที่นักวิทยาศาสตร์เหล่านี้ได้แสดงให้เห็น เทคโนโลยีระบบอัตโนมัติที่กำลังพัฒนาเพื่อต่อสู้กับข้อมูลที่บิดเบือนอาจยังไม่พร้อมสำหรับภารกิจนี้

อ่าน: